SIGGRAPH2015個人的注目論文まとめ

はじめに

こんにちは!間接照明ちゃん(間接照明ちゃん (@IndirectLight) | Twitter)です!

この記事は第三回レイトレ合宿のアドベントカレンダーです。

SIGGRAPH2015を夏に控え、テクニカルペーパーやコースの情報が随時公開されています。今回はテクニカルペーパーの中から個人的に気になっているものを列挙していきます。といってもタイトルからの直感ばっかりなのでガチ勢は自分で見ましょう(SIGGRAPH 2015 Papers)

Technical Paper Previewも見ましょう。

Doppler Time-of-Flight Imaging

なんか名前がかっこいいですね。ToF式のカメラといえばKinect v2があります。これは光を物体に照射して反射、カメラに再び戻ってくる時間を計測することで対象までの距離を計測する仕組みですが、Dopplerとついているのでカメラを動かしてDoppler Effectを利用するのかもしれません。詳細は不明です。

Stripe Patterns on Surfaces

Carnegie Mellon Computer Graphics

しましま模様は自然界にたくさん存在します。たとえばサボテンとか。図はウェブサイトからコピペしました。そういうしましま模様を任意の三角形メッシュ上に発生させるための論文らしいです。しましまは途中で枝分かれもでき、ユーザーが自由にコントロールできます。計算コストも、典型問題に帰着させることでいい感じみたいです。これで3D縞パンも作り放題ですね。

Dynamic 3D Avatar Creation from Hand-held Video Input

Dynamic 3D Avatar Creation from Hand-held Video Input

アイフォンみたいな手持ちカメラで撮影した動画を基に三次元の顔モデルを復元する論文です。なんとアニメーションも付きます。すごい!リグとかも入れてくれるみたいです。この手のお手軽デバイスでお手軽モデリング系は、どんだけワークフローをお手軽にできるかにかかってると思いますが、どんだけお手軽かは結局論文読んでもあんまわかんなくて実際にやらないと何とも言えないですよね。でも期待感が高まります。

Multi-Scale Modeling and Rendering of Granular Materials

Multi-Scale Modeling and Rendering of Granular Materials

Multi-Scale Modeling and Rendering of Granular Materials

細かい粒が沢山集まって出来るような物体(砂とか雪とか砂糖とか)をどうモデリングするか、そしてどうレンダリングするか、という問題を効率的に取り扱った論文です。細かいつぶつぶについて事前計算を行っておき、ランタイムにはそれを参照することで高速にパストレーシングしてレンダリングするようです。

著者らにDisney Researchの人間が多く名を連ねているのは今後のDisneyアニメーションでこの技術が活用されるということでしょうか。されないかもしれませんが。

まあDisneyやPixarのアニメーション映画で実際に使われた技術が論文になるのは良くある話なのでありえないことでもないでしょう。

Restoring Missing Vortices in Advection-Projection Fluid Solvers

IVOCK

流体シミュレーションでは移流ステップでVortisityが失われることが多いですが、損失を抑えて細かいディテールを残したままシミュレーションを行う、という論文です。

計算コストもそこまで大きく増大しないので実用性がありそうです。シミュレーションは速度場ベースではなく渦度ベースのようです。

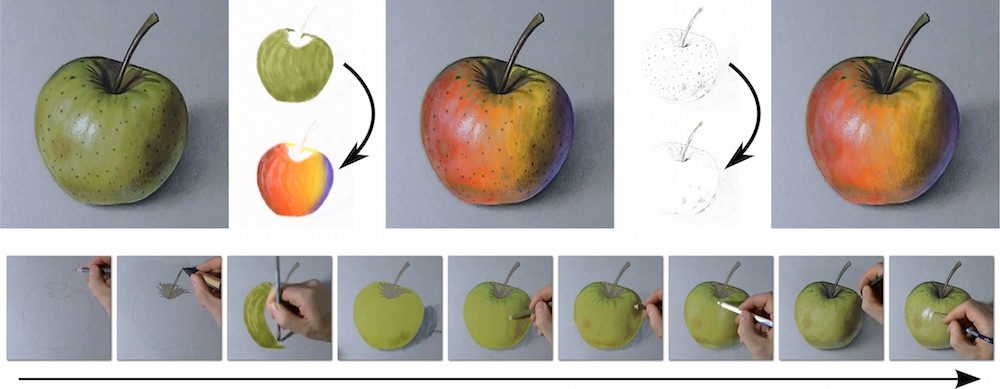

Decomposing Time-Lapse Paintings into Layers

Decomposing Time-Lapse Paintings into Layers

これは動画を見た方が分かりやすいですね。絵を描くとき、最後に残るのは結果とての絵だけであり描く過程は失われてしまいます。しかし、この手法により描く過程をタイムラプス動画として撮影し後から分析することで個々のストロークを独立に編集したり色を変えたりすることが可能になります。

一度レンダレングしたCG画像を後からライティング変更したりするリライティングと呼ばれる技術がありますが、これはリペインティグとでも言うのでしょうか。面白いですね。

Dehazing using Color-Lines

Dehazing using Color_lines

あんまちゃんと読んでないですが、もやがかかったような画像からもやを取り除く手法のようです。こういうのって、真値を得られなそうだし結構評価とか難しそうですよね。どうやってんですかね。気になった人は論文を読んで教えてください。

An L1 Image Transform for Edge-Preserving Smoothing and Scene-Level Intrinsic Decomposition

An L1 Image Transform for Edge-Preserving Smoothing and Scene-Level Intrinsic Decomposition

L1ノルムを利用してごにょごにょすることで、画像のエッジを保存したままスムージングを行う手法です。このような変換を行うことで、大局的な特徴を保持したまま細かいディテールをなくしたような画像を得たり、Intrinsic Decompositionを行うことが出来ます。Intrinsic Imageは画像からシェーディングだけを除いたような画像のことで、物理的厳密さは乏しい場合が多いのですが反射率とシェーディングを分離することで画像に対してテクスチャを尤もらしく貼りなおしたり出来ます。

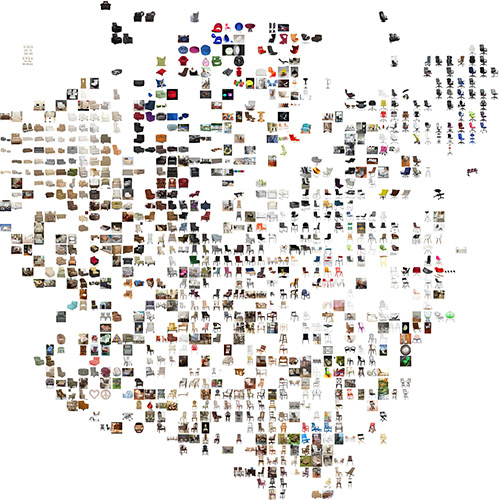

Single-View Reconstruction via Joint Analysis of Image and Shape Collections

Shape_Driven_Recons

単一画像からの3D復元系論文です。図は、ウェブで検索した適当な椅子画像で、単一方向からの椅子画像より右図のような3Dモデルの復元に成功しています。

事前に大量のリファレンス3Dモデル+画像を用意し、それらを学習させることで単一方向からの復元という難題に対応しているみたいです。

ただ、椅子しか学習していなければ椅子画像しか取り扱えないようですね。一般化のためにはデータ量がモノをいうのかもしれません。

Foldabilizing Furniture

Foldabilizing Furniture

画像が全てです。入力された椅子みたいな3Dモデルに対して、方向や使用するヒンジなどの構造を与えることで、折り畳み可能な形状に変換する方法を提案している論文です。図では横方向に折りたためるようにしたパターンと、手前に折りたためるようにしたパターンが例示されています。

生成された折り畳み可能なモデルは、3Dプリントして実際に折りたためることを示したようです。きっと発表会場にも持ってきてくれることでしょう。

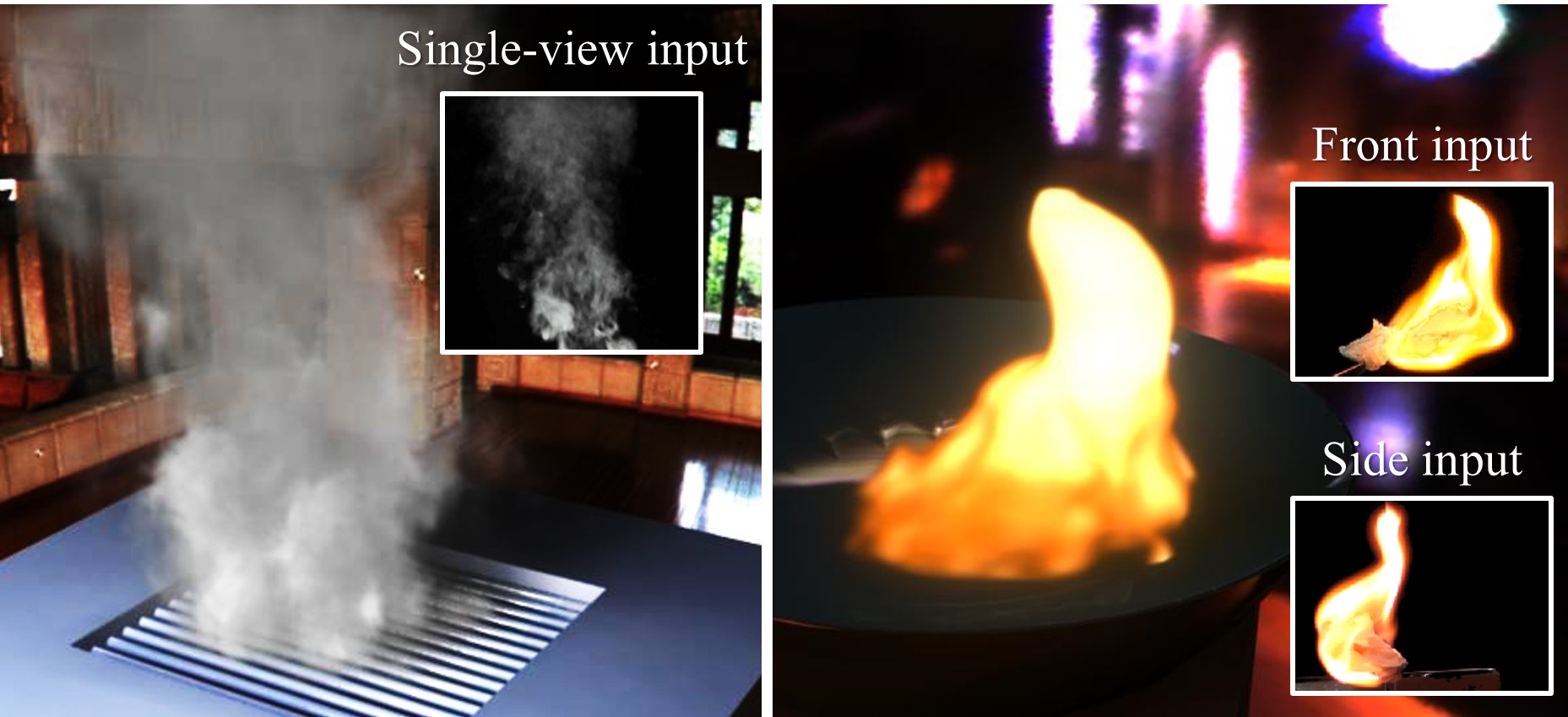

Fluid Volume Modeling from

Sparse Multi-view Images by Appearance Transfer

Makoto Okabe's Home Page

3Dボリュームを数か所(そんなに多くはなくて良いようです。Sparseなので)からの撮影画像を基にモデリングするという論文です。従来の似たような方法では、このようなわずかな視点からの画像に基づいて3Dボリュームをモデリングしてしまうと、その視点からは質のいいボリュームが得られても新しい視点から見ると全然ダメ、ということが多かったようですが、この手法は見た目に関してある種の定量化を行いモデリングされたボリュームを別視点から見たときに、定量化された見た目がちゃんと維持されるように反復的にボリュームを最適化することでどの方向から見ても破綻の無いボリュームを得ているようです。

Learning Visual Similarity for Product Design with Convolutional Neural Networks

Sean Bell | Cornell University

デモサイト

Deep Learning系論文です。当然SIGGRAPHにも押し寄せてきましたね。

写真から切り出した画像や、あるいは何らかの製品とかの画像を入力として与えると、類似した写真を検索して提示してくれるシステムの提案です。これを実現するために画像間の類似度を判定する関数をConvolutional Neural Networksを用いて学習したそうです。(具体的にはsiamese networks)

関係ないですけど、著者のSean Bell氏、トップカンファに通りまくっててすごいですね。

Computational Design of Twisty Joints and Puzzles

Computational Design of Twisty Joints and Puzzles

ルービックキューブのような回転パズルを、任意の入力3Dモデルから生成するという論文です。ユーザーは、入力モデルと回転軸(のサブセット)を与え、それに基づいて回転時に自己衝突が起こらないようにモデルを変形させつつ、3Dプリントして組み立てられるような形状を計算してくれるようです。

Image Based Relighting Using Neural Networks

まだ全然詳細が出てないのですが、NN使ってイメージベースリライティング、アツイですね。

Animating Human Dressing

Animating Human Dressing

人が衣服を着るときのアニメーションを生成する論文です。

事前に衣服を着る時の人間の動きを観察して多数の細かい要素に分解します。シミュレーション時には、着せ衣服に基づいてそれぞれの要素を合成して組み合わせることで服を着るまでのパスを生成します。

A Machine Learning Approach for Filtering Monte Carlo Noise

A Machine Learning Approach for Filtering Monte Carlo Noise

モンテカルロレンダリングにつきもののノイズを減らすための手法についての論文です。このようなノイズを減らすための手法は既に様々なものが提案されていますが、本質的には何らかのフィルタ(バイラテラルとか)の重みをどう決定するか、という内容です。この論文では、この重みをニューラルネットワークを使って機械学習させたモデルを利用して決定しています。

学習データはそんなに多くないしネットワークの規模も最近はやりのDeep Neural Networkに比べてもそんなに大きくないのですが、結果はかなり良好に見えます。ただ、一部のパラメータは実験で求めてたりして若干アドホックっぽいところがあるのも否めません。全パラメータを完全に学習で決定してほしかったところです。

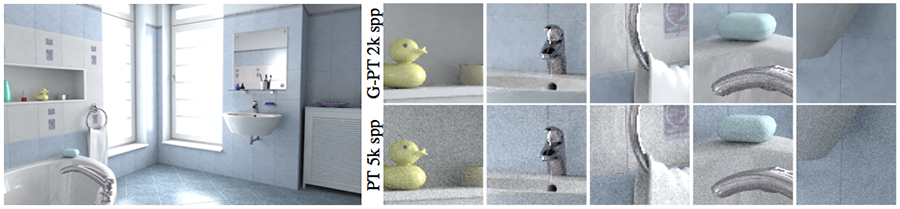

Gradient-Domain Path Tracing

Gradient-Domain Path Tracing

レンダリング手法の論文です。この手法では、画像そのものに加えて画像の勾配を同時にレンダリングし、最後にポアソン問題に帰着させて画像をリコンストラクションすることでレンダリングを行います。画像そのものをレンダリングするのに比べて、勾配を得てから復元することで、画像中のノイズをいい感じに低減できます。(誤差拡散みたいな)

この手の勾配レンダリング手法は以前より何本か論文が出ていましたが、基本的にメトロポリス法に基づいていました。この論文はさらに手法を一般化し普通のパストレーシングでも有用であることを示したそうです。

Stable Constrained Dynamics

Stable Constrained Dynamics

物体間の拘束条件に基づいて物理シミュレーションを行う手法がConstrained Based Dynamicsです。このような手法では、最終的に何らかの行列が得られてその行列を解くことでタイムステップを進める、というのが一般的です。この論文はその行列に対して若干の変更を加え(若干の計算コストの増大によって)シミュレーション全体を安定にしたそうです。

例えば、力のかかる方向にたいして物体の動く方向が直交しているとシミュレーションは不安定になるらしいのですが(トランポリンに張られた面とか。面は上下に運動する一方、台とは横方向の糸で張られる)この提案法はそのような状況下でも安定にシミュレーションを進めることができるらしいです。

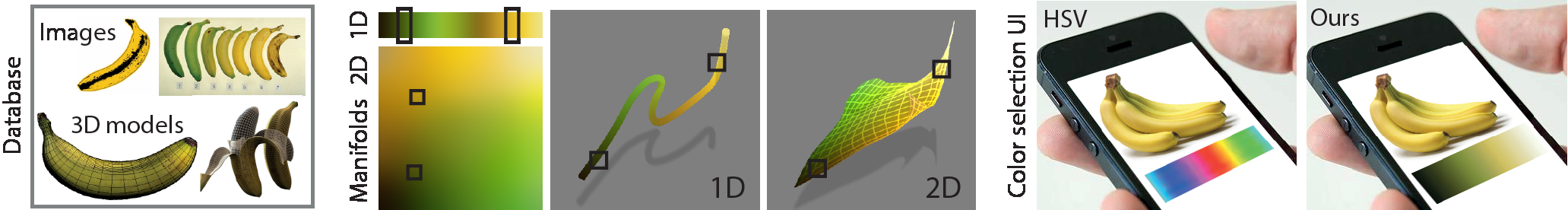

Data-driven Color Manifolds

Data-driven Color Manifolds

従来、CG分野における色選択インタフェースといえば1Dか2Dのものばかりでしたが、本来三次元空間の点であるところの色をこのようなインタフェースで操作するのは困難です。この論文では、一般的な色空間(RGBやHSVなど)の上で操作するのではなく、コンテキストごとに定義されたColor Manifoldの上で操作し、対象画像に対して行うであろう尤もらしい色操作を簡便に行えるようにしたそうです。

コンテキストの判定は教師アリ学習によるデータドリブンな感じでやります。

Vector Graphics Animation with Time-Varying Topology

動画を見てもらうのが早いでしょう。ベクター画像のアニメーションを三次元空間に展開して編集することで、二次元スクリーン上で編集するよりもはるかに効率的に目的のアニメーションを実現できる、というものです。

まとめ

とりあえず、一通り見て私が面白そうと思った論文をセッションごとに一本ずつくらいの間隔で紹介してみました。まだ公開されていない論文もたくさんあるので、わりとフィーリングです。しかし、どの論文もウェブサイトが綺麗で凝ってますね。CG系の人たちはみんな見た目にすごい気を使います。